20230411 0909

REF

[1] 정석으로 배우는 딥러닝

[2] https://medium.datadriveninvestor.com/the-math-and-intuition-behind-gradient-descent-13c45f367a11

The Math and Intuition Behind Gradient Descent

Agile software development defines the iterative product development process by which the following steps are exercised.

medium.datadriveninvestor.com

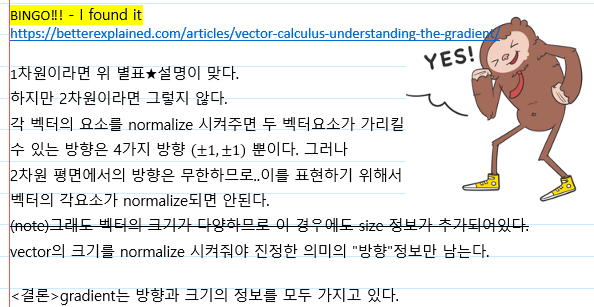

[3]https://betterexplained.com/articles/vector-calculus-understanding-the-gradient/

Vector Calculus: Understanding the Gradient – BetterExplained

The gradient is a fancy word for derivative, or the rate of change of a function. It’s a vector (a direction to move) that Points in the direction of greatest increase of a function (intuition on why) Is zero at a local maximum or local minimum (because

betterexplained.com

동기

Gradient Descent Method(GD)는 x*를 찾아가기 위해 x0에서 출발행서 dx만큼씩 최적값으로 이동하는 알고리즘이다.

x0+dx = x1, repeat this until find x*

그런데 dx가 a*f'(x)로 정해지는데..f'(x)는 x의 변화분이 아니라 y의 변화분에 가깝다. f'(x)=dy/dx

(정확히는 y의 변화분과 x의 변화분의 비율)

x의 변화량을 더해야하는데 왜 y의 변화량을 더할까?

인터넷에 찾아본 결론은 f'(x) 또는 Gradient가 "방향"이라고 해석하면된다는 건데, 사실 Gradient는 방향뿐만 아니라 크기도 가지고 있다.

찾아낸 결론

따라서 방향정보만 필요한데, 크기정보를 gradient 앞에 곱해주는 학습률 learning rate로 조정해주는 것으로 볼 수 있다.

사족;

Gradient Descent 방법은 convex하고 smooth한 function에 대해서만 성립한다.

'[AI]Artificial Inteligence 인공지능' 카테고리의 다른 글

| AI 큰 그림 Story telling of Deep Learning (1) | 2023.04.15 |

|---|---|

| AI Newton Raphson method 이해 (0) | 2023.04.11 |

| AI 이진분류 다중분류 (0) | 2023.03.30 |

| AI 단순 퍼셉트론은 선형분류만 가능 (0) | 2023.03.26 |

| AI Sigmoid 함수 (0) | 2023.03.25 |