20230414 1225

1. 인공지능 > Machine Learning > Deep Learning

- 비슷한 단어지만 다르다.

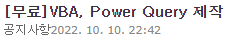

2. Deep Learning의 시작은..Perceptron

- AND, OR 등 논리게이트에 적용해보자(simple example)

2.1 최적화

계단함수 대신에 Sigmoid함수를 도입하면 결과를 확률로 해석할 수 있겠다.

그럼 "우도함수" 개념을 도입 ⟶ 최적화를 통한 파라메터(w1, w2, b) 추정

우도(likelihood)와 확률(probability)

확률함수는 뭘 넣으면 확률을 돌려주고, 우도함수는 뭘 넣으면 우도를 돌려주는데..

우도함수를 이용해서 파라메터를 구한다는 점에서 우도함수는 뭘 넣으면 파라메터를 돌려준다고 보자.

- 확률함수 : given 파라메터 ⟶ 확률

- 우도함수 : given 결과값 ⟶ 파라메터

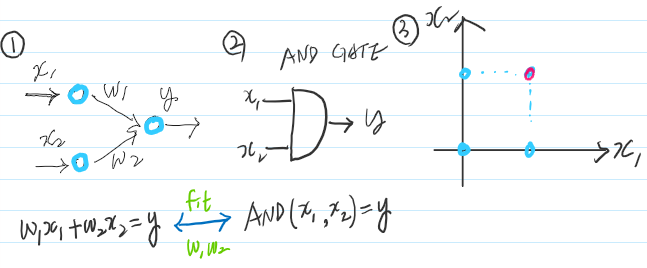

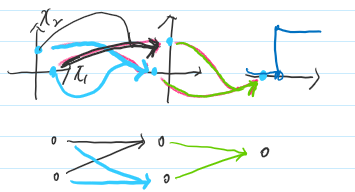

3. 그런데 Perceptron으로 안되는 논리게이트가 있다: XOR

-> Deep Learning ; Perceptron의 결합 또는 Hidden Layer의 추가

(개념)

(수식)

not AND와 OR를 섞으면 만들 수 있겠다..

3.1 최적화 - back propagation

- Hidden Lay가 생겨 최적화 과정이 달라져야 한다.

4. 실습 - to be continued

'[AI]Artificial Inteligence 인공지능' 카테고리의 다른 글

| AI OR gate, Regression (vs Deap Learning) (0) | 2023.04.27 |

|---|---|

| AI deep learning도 error minimizing 개념 (0) | 2023.04.24 |

| AI Newton Raphson method 이해 (0) | 2023.04.11 |

| AI understanding Gradient Descent 경사하강법 이해 (0) | 2023.04.11 |

| AI 이진분류 다중분류 (0) | 2023.03.30 |